0) “LLM이 다 알려주는데… 굳이 책이 필요해?”에서 다시 시작한 이유

저는 한동안 “필요하면 Copilot/Gemini CLI로 물어보면 되지” 쪽에 더 가까웠습니다. 실제로 질문-답변 속도는 압도적으로 빠르고요.

그런데 AI 에이전트 쪽은 조금 다르더라고요.

프롬프트를 잘 쓰는 것과

**‘도구를 붙이고, 상태를 유지하고, 실패를 다루고, 운영 가능한 형태로 만든다’**는 건

완전히 다른 게임이었습니다.

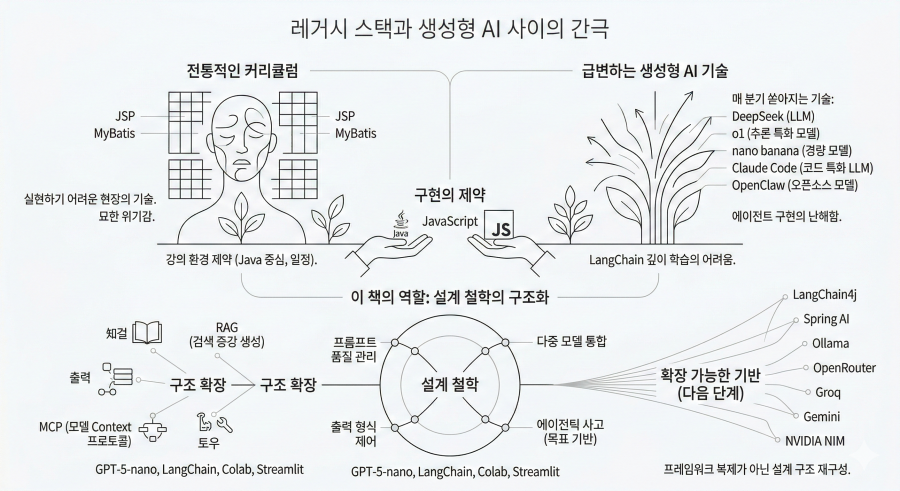

LLM은 제 궁금증을 즉시 풀어주지만, 지식의 순서와 큰 그림(설계 흐름)을 강제해주진 않아요.

에이전트는 특히 “어디서부터 어디까지가 핵심이고, 어떤 선택이 왜 필요한지”가 흐릿하면, 검색하다가 하루가 다 가버립니다.

그래서 이번 책은 제게 “에이전트 개발을 시작할 때 필요한 스타터팩(커리큘럼)” 같은 의미였어요.

처음부터 끝까지 따라가면, 최소한 *‘내가 뭘 모르는지’*가 선명해집니다.

1) 이 책이 제일 잘하는 것: “표준화”를 현실적인 언어로 연결해줌

요즘 “에이전트”라는 단어가 너무 남용되다 보니, 실제 구현을 모르고서는 계속 답답한 상태로 남기 쉽습니다.

이 책이 좋았던 건, 그 답답함을 **“표준화된 도구 체계”**로 정리해준다는 점이었어요.

제가 책을 읽고 나서 정리한 정의는 이렇습니다.

LangChain: LLM을 서비스로 만들 때 반복되는 것들(프롬프트, 체인, 메모리, 툴 호출, RAG)을 “프레임워크 문법”으로 정리해둔 도구 상자

MCP(Model Context Protocol): 에이전트가 외부 도구(파일, API 등)를 붙일 때, 매번 제각각 구현하지 않도록 하는 연결 규약(표준 인터페이스)

“아, 이게 결국 에이전트를 제품/서비스로 만들기 위한 표준화 레이어구나” 하고 납득되는 순간이 옵니다.

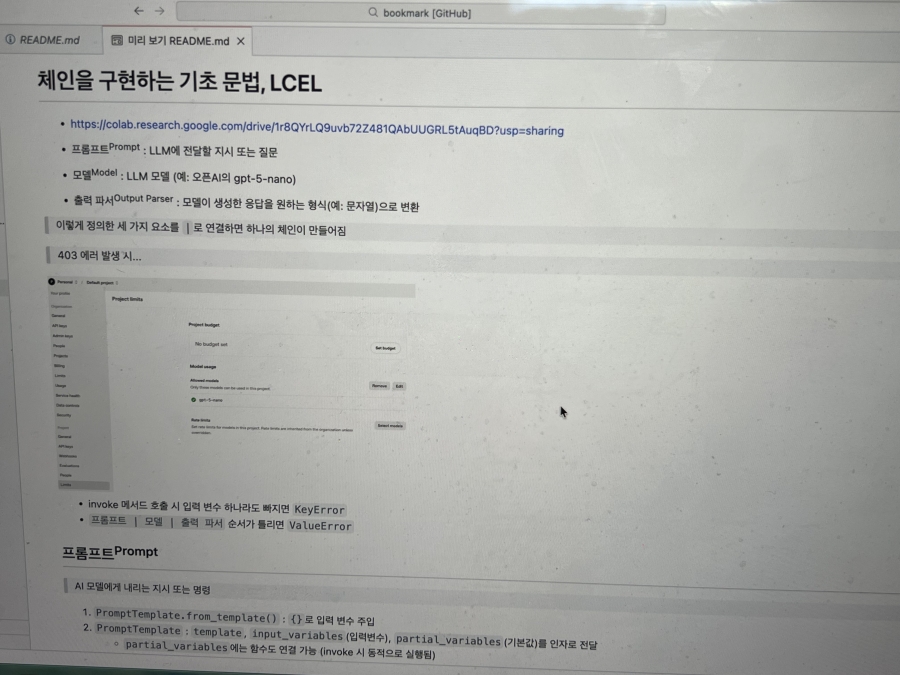

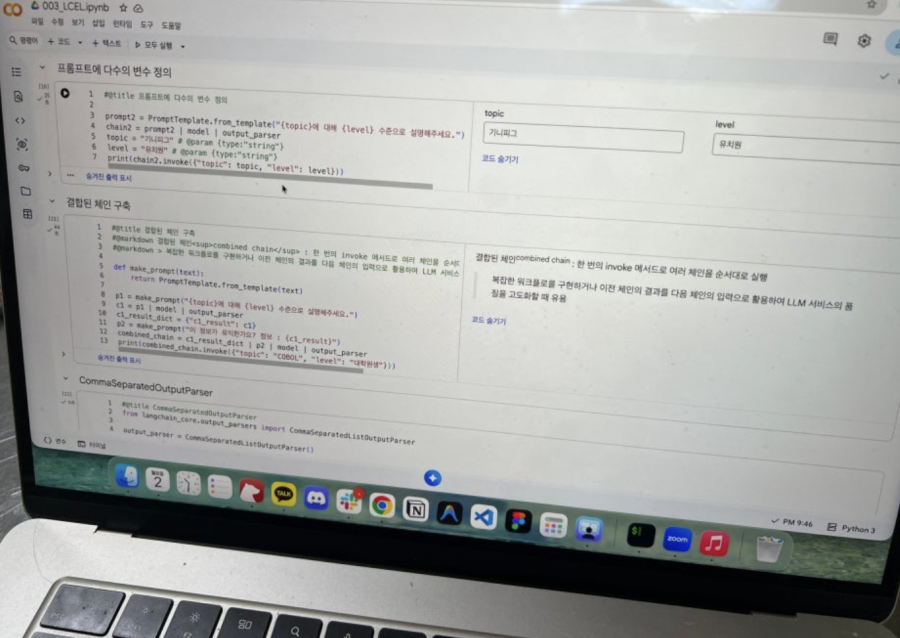

2) Part 1 (LCEL·Runnable·Memory): “내 코드가 어디서 망가지는지”가 보이기 시작함

Part 1은 한마디로 LLM 서비스의 데이터 흐름을 ‘코드 구조’로 정리하는 파트였습니다.

특히 LCEL을 Prompt | Model | OutputParser로 이어 붙이는 방식으로 배우다 보면,

제가 예전엔 대충 처리했던 부분들이 하나씩 드러납니다.

프롬프트 템플릿이 어디서 완성되는지

모델 호출 이후 결과를 어떤 형태로 구조화해야 운영이 되는지

“체인”이 단지 연결이 아니라, 예측 가능한 파이프라인이라는 것

제가 실무에서 자주 겪었던 문제는 이거였어요.

“데모는 되는데, 운영에서 깨진다.”

운영에서 깨지는 이유는 대부분 “흐름이 불명확해서”였고,

Part 1은 그 흐름을 디버깅 가능한 형태로 강제해줍니다.

특히 Memory를 다루는 챕터는,

“대화를 기억하게 한다” 수준이 아니라 대화 기록을 어떤 구조로 관리할지가 포인트였고요.

3) Part 2 (ReAct·RAG·LangGraph·MCP): 에이전트는 “추론”보다 “운영 구조”가 핵심이었다

Part 2는 제가 기대했던 핵심이었습니다.

요즘 에이전트 이야기할 때 다들 ReAct(Thought→Action→Observation)를 말하잖아요.

근데 책을 따라가며 느낀 건…

**ReAct는 시작이고, 진짜 난이도는 그 다음(상태·지식·도구·표준화)**였습니다.

RAG: “검색 붙이면 끝”이 아니라

청킹/메타데이터/Top-k/MMR 같은 선택들이 결국 품질과 비용을 좌우함

LangGraph/CheckPointer:

대화 상태를 유지하는 게 “편의 기능”이 아니라

장기 운영에서 필수 인프라라는 걸 체감함

MCP:

여기서 확실히 “에이전트 생태계” 느낌이 납니다

도구 연결이 각자 구현이면 결국 파편화가 오는데,

MCP는 그걸 규약으로 제압하는 느낌이었어요

책의 와인 소믈리에 프로젝트가 좋았던 이유도 여기에 있습니다.

“그럴듯한 데모”가 아니라, 도구-지식-UI까지 묶어서 서비스 형태로 완성해보게 하거든요.

4) 저는 OpenAI API 대신 “로컬 LLM(Ollama)”로도 충분히 소화했어요

책은 OpenAI API 기준으로 진행되지만, 저는 비용/프라이버시/실험 편의 때문에 로컬도 병행하는 편입니다.

마침 요즘 OpenClaw 같은 툴도 만지면서, “모델 성능”보다 주변 시스템 설계가 더 중요하다는 걸 체감하는 중이었고요.

그래서 Part 1의 기본 실습은 Ollama + langchain-ollama로 바꿔서 진행해도 큰 무리가 없었습니다.

작은 모델이어도

체인/메모리/RAG/툴 연결 개념은 그대로 학습되니까요.

오히려 로컬로 돌리면 “토큰 비용”에 대한 심리적 부담이 없어서

실습을 여러 번 깨먹고 다시 만드는 데 도움이 됐습니다.

5) 이 책이 잘 맞는 사람 / 안 맞는 사람 (제가 느낀 기준)

잘 맞는 사람

“에이전트를 만들고 싶다”가 아니라 **“에이전트를 서비스로 붙이고 싶다”**인 실무자

RAG/MCP/LangGraph를 단어만 아는 상태에서 전체 그림이 필요한 사람

PoC가 아니라 “운영 가능한 형태”를 염두에 두는 개발자/테크 리드

안 맞을 수 있는 사람

파이썬이 낯선 완전 입문자

“개념만 가볍게 읽고 싶다”는 사람 (이 책은 손을 움직이게 만듭니다)

총평: “버즈워드로서의 에이전트”를 끝내고, “구현 가능한 에이전트”로 넘어가게 해준 책

요즘 ‘에이전트’라는 말이 너무 흔해져서,

오히려 **“그래서 정확히 뭐가 진화한 건데?”**라는 답답함이 커진 시기라고 생각합니다.

<AI 에이전트 마스터 클래스>는 그 답답함을

LangChain으로 구조를 잡고

RAG로 지식을 붙이고

LangGraph/CheckPointer로 상태를 운영하고

MCP로 도구 연결을 표준화하는

실전 개발 흐름으로 해소해줍니다.

저처럼 “대충은 아는데 손에 안 잡히는 상태”였던 분들에게 특히 추천합니다.

읽고 나면 적어도, 에이전트를 말할 때 **“어디까지가 모델이고, 어디부터가 시스템인지”**를 구분해서 설명할 수 있게 됩니다.