IT/모바일

※ 딥러닝 소개

본격적으로 활약하기 시작한 딥러닝은 머신러닝의 분야들을 하나하나 정복해 나가기 시작했습니다. 가장 먼저 두각을 나타낸 곳은 이미지 분류 문제인 이미지넷ImageNet 대회였지만 가장 먼저 상용화 부문에서 빛을 본 분야는 음성 인식 쪽이었습니다. 음성 인식은 종전에 사용하던 가우 시안 혼합 모델Gaussian mixture model(GMM)을 심층 신경망deep neural network(DNN)으로 대체한 것만 으로 십수 년의 정체를 뚫고 한 차례 큰 발전을 이루어냈습니다. 상대적으로 가장 나중에 빛을 본 곳은 자연어 처리 분야였습니다. 아마도 이미지 분류나 음성 인식의 음소 인식과는 달리, 자연어 처리는 단어 간의 순서 및 상호 정보가 반영된 시퀀셜 데이터sequential data라는 점이 더 큰 장벽으로 다가왔을 것입니다. 하지만, 결국엔 어텐션 메커니즘의 등장으로 인해서 요원해보이던 기계번역 분야마저 end-to-end 방식의 딥러닝에 의해 정복되었습니다.

※ 딥러닝의 역사

지금부터 딥러닝의 역사를 간단히 살펴봅니다.

| 2010년 이전 |

인공 신경망artificial neural network을 필두로 한 인공지능의 유행은 처음이 아닙니다. 지금까지 두 번 의 대유행이 있었고, 그에 따른 두 번의 빙하기가 있었습니다. 1950년대에 이어 두 번째 황금 기였던 1980년대에 역전파back propagation 알고리즘이 제안된 후 기존의 문제는 해결된 듯 보였으나, 다시금 여러 한계점을 드러내며 두 번째 침체기를 맞이했습니다. 모두가 인공 신경망의 가능성을 부인하던 2006년, 제프리 힌튼Geoffrey Hinton 교수는 딥 빌리프 네트워크라 불리는 심층 신뢰 신경망deep belief network(DBN)을 통해 여러 층의 은닉층hidden layer을 효과적으로 사전훈련pretraining시킬 방법을 제시했습니다. 하지만, 그때까지만 해도 가시적인 성과가 나오지 않았기 때문에 모두의 관심을 집중시키기는 어려웠습니다. 실제로 필자 주변에서도 1990년대의 두 번째 빙하기를 겪어본 분들은 다시 딥러닝이 주목을 끌기 시작했을 때 대부분 부정적인 반응을 보였습니다. 딥마인드가 체스 챔피언에 등극하고 이미지넷에서 새로운 알고리즘을 적용한 신경망이 계속해서 최고 성능을 갈아치우며 모두가 열광할 때도 단순히 잠깐의 유행일 것으로 생각하는 분도 많았습니다. 하지만 점차 딥러닝은 여러 영역을 하나둘 정복해나가고 있습니다.

| 이미지 분류 |

2012년 이미지넷에서 인공 신경망을 이용한 AlexNet은 경쟁자들을 큰 차이로 따돌리고 우승하며 딥러닝의 시대의 서막을 올립니다. AlexNet은 여러 층의 합성곱 계층convolutional layer을 쌓아서 네트워크 구조를 만들며 기존 우승자들과 확연한 실력 차를 보여주었습니다. 당시 AlexNet은 3GB 메모리의 Nvidia GTX580을 2개 사용하여 훈련했는데, 지금 생각하면 참으 로 격세지감이 아닐 수 없습니다.

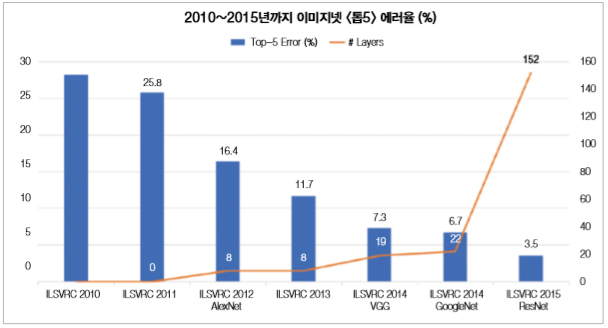

▶ 이미지넷의 최근 성능 변화

이후, 딥러닝의 경연장이 된 이미지넷 대회에서는 거의 모든 참가자가 딥러닝을 이용하여 알고리즘을 구현했습니다. 결국 2015년 ResNet이 레지듀얼 커넥션residual connection을 활용하여 150층이 넘는 깊은 네트워크를 구성하며 우승했습니다. 하지만, 안타깝게도 이러한 연구 결과와는 별개로 실생활에서의 이미지 분류image classification 문제에는 아직 어려움이 남아 있는 것이 사실입니다. 이미지 분류 자체의 난도가 워낙 높기 때문입니다. 따라서 여전히 산업계에서는 이와 관련한 많은 연구와 개발이 이루어지고 있습니다.

| 음성 인식 |

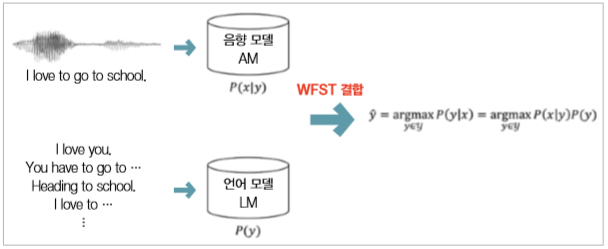

음성 인식speech recognition 분야에서도 딥러닝을 활용하여 큰 발전이 이루어졌습니다. 오히려 이 분야는 영상 처리computer vision 분야에 비해 딥러닝 기술을 활용하여 상용화까지 성공한 더욱 인상적인 사례라고 할 수 있습니다. 사실 음성 인식은 2000년대에 들어 큰 정체기를 맞이하고 있었습니다. GMM을 통해 음소phone를 인식하고, 이를 은닉 마르코프 모델hidden Markov model(HMM)을 통해 시퀀셜 정보를 반영해 학습하여 만든 음향 모델acoustic model(AM)과 n-gram 기반의 언어 모델language model(LM)을 WFSTweighted finite state transeducer 방식을 통해 결합하는 전통적인 자동음성인식automatic speech recognition(ASR) 시스템은, 여기까지 쓴 설명에서도 알 수 있듯이 너무나도 복잡한 구조와 함께 그 성능의 한계를 보이고 있었습니다.

▶ 전통적인 자동음성인식 시스템의 구성

그러던 중, 2012년 GMM을 DNN으로 대체하며 십수 년간의 정체를 단숨에 뛰어넘는 큰 혁명을 맞이합니다(영상 처리와 자연어 처리에서 모두 보이는 익숙한 패턴입니다). 그리고 점차 음향 모델 전체를 LSTM으로 대체하고, end-to-end 방식이 성과를 내고 자리잡는 추세입 니다.

| 기계번역 |

인공지능의 다른 분야에 비해 자연어 처리나 기계번역 분야는 이렇다 할 큰 성과를 거두지 못하고 있었습니다. 하지만 무섭게 밀려드는 딥러닝의 기세 앞에서 자연어 처리 분야 또한 예외일 순 없었습니다. 특히, 자연어 처리의 종합예술이라 할 수 있는 기계번역도 결국 딥러닝에 의해 평정됩니다.

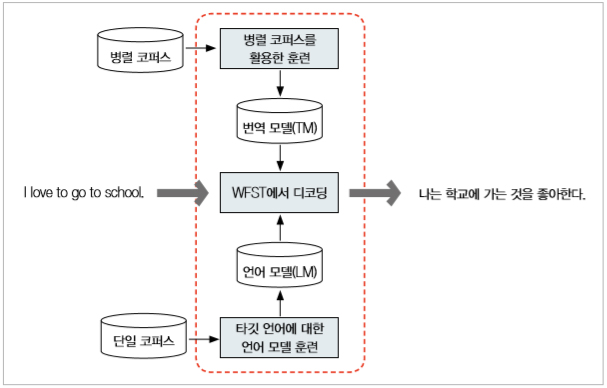

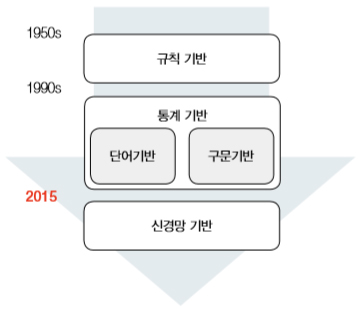

딥러닝 이전의 기계번역은 통계 기반 기계번역statistical machine translation(SMT)이 지배하고 있었습니 다. 통계 기반 기계번역 시스템은 규칙 기반 기계번역rule-based machine translation(RBMT) 방식에 비해 언어 간 확장이 용이한 장점이 있었고 성능도 더 뛰어났지만, 음성 인식과 마찬가지로 매우 복잡한 구조를 지니고 있었습니다.

▶ 통계 기반 기계번역 시스템을 구성하는 서브 모듈

그러던 중 2014년 이후 seq2seq라는 모델 구조가 소개되며 end-to-end 신경망 기반 기계 번역neural machine translation(NMT)의 시대가 열리게 되었습니다. seq2seq를 기반으로 어텐션 메커니즘attention mechanism이 제안되며 결국 기계번역은 신경망 기계번역으로 대통합이 이루어집니다.

▶ 기계번역의 역사

이러한 점에서 기계번역은 가장 늦게 혁명이 이루어졌지만, 가장 먼저 딥러닝만을 활용해 상용화된 분야입니다. 현재의 상용 기계번역 시스템은 모두 딥러닝에 의한 시스템으로 대체되었다고 볼 수 있습니다.

| 생성 모델 학습 |

딥러닝은 패턴 분류 성능에서 타 알고리즘에 비해 매우 압도적인 모습을 보여주었으므로, 이미지 분류나 텍스트 분류와 같은 단순한 분류 문제(또는 판별 모델 학습discriminative model learning)는 금방 정복되었습니다. 이에 연구자들은 곧 또 다른 흥미거리를 찾아 나섰는데, 바로 생성 모델 학습Generative model learning이었습니다. 각 방식을 공식으로 표현하면 다음과 같습니다.

기존의 판별 모델 학습은 데이터 X가 주어졌을 때 알맞은 레이블 Y를 찾아내는 것에 집중했다면, 이제는 데이터 X 분포 자체를 배우는 것에 집중합니다. 예를 들어 기존에는 사람의 얼굴 사진 데이터가 주어지면 남자인지 여자인지, 또는 이 사람이 누구인지 레이블을 맞히려 했다면, 이제는 사람의 얼굴 자체를 묘사할 수 있는 모델을 훈련하고자 했습니다. 이러한 과정에서 적대적 학습adversarial learning이나 변분 오토인코더variational autoencoder(VAE)등이 주목받게 되었습니다. 이러한 연구는 여전히 현재 진행형이며, 이와 관련한 많은 문제가 남아 있습니다.

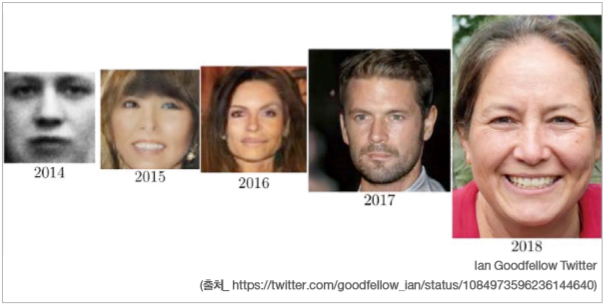

▶ 2014년부터 2018년까지 생성적 적대 신경망(GAN)의 발전 사례

김기현의 자연어 처리 딥러닝 캠프(파이토치 편) 자세히 보러가기

이전 글 : 폰 노이만과 새로운 컴퓨터의 탄생

다음 글 : 비즈니스 컴퓨팅의 시작

최신 콘텐츠